requestId:689271c4b036d6.05701276.

中國網/中國發展門戶網訊 正如過往工業時代的蒸汽機和電力一樣,隨著數據的積累、算法的進步,以及算力的進步,人工智能(AI)技術正重塑人類世界。ChatGPT(天生式預訓轉換機器人)的誕生就是智汽車零件報價能機器人發展的一個階段性進步。可是,在代替傳統搜刮引擎成為人類任務和生涯更為方便的“百科全書”的同時,ChatGPT也使得人們產生諸如學生應用AI作弊、數據泄露、后臺技術操控者價值滲透等倫理隱憂。

從理論上講,人工智能能夠存在技術掉控和技術的非正當應用風險。技術掉控,指隨著技術的發展,人工智能不僅會超出人類的把持才能,還有能夠擺脫人類的把持獨立發展甚至反噬人類。由于當前產業年夜部門場景長短封閉的,現有的弱人工智能遠遠無法達到把持人類的水平,暫不存在掉控風險。技術的非正當應用包含無意的技術誤用和有興趣的技術濫用2類;在封閉條件下,人工智能技術自己是中性的,能否出現誤用或濫用,取決于在實際場景中具體應用的公道性(即正當與否)。假如應用在正當領域,如偵查部門應用人臉識別技術抓獲大批犯法嫌疑人,產生的是正面反饋;假如應用在非正當領域,如犯法分子應用“深度偽造”(deepfake)詐騙、訛詐,則會導致隱私泄露、錢財損掉等負面反饋。

在數據智能社會佈景下,全球范圍內管理人工智能倫理的國際硬法缺位、國際軟法發達。同時,國際軟法也面臨著國際軟法主體間一起配合不穩定、有時得不到有用實施的管理挑戰。今朝國內外均尚未提出針對該領域管理窘境的可行建議,因此本文重要考核當前國際軟法管理人工智能倫理的現狀及挑戰,并提出國際軟法管理對策。

國際軟法管理人工智能倫理的現狀

國際軟法因具有靈活高效、適用本錢低,能填補硬法空缺,以及便利區分管理、分層應對倫理問汽車零件進口商題的優勢,其在人工智能倫理管理方面的勃興幾乎是必定的。

人工智能技術觸及的倫理問題

人工智能技術所觸及的倫理問題重要包含但不限于公道性問題、可控性問題和嚴重社會問題。

公道性問題,指一項人工智能技術的應用倫理上的負效應接近或超過可容忍范圍。數據智能社會中,人們在日常生涯中應用大批智能產品;假如網絡黑客通汽車材料過惡意法式遠程操縱無人駕駛汽車系統、人類心臟智能起搏器等,都可以輕易致人逝世亡。在人工智能系統處理大批敏感信息和個人數據的過程中,數據被淨化、泄露、濫用,不僅會影響輸出結果,還能夠危及人身財產平安、經濟社會次序甚至國家平安。人工智能技術的設計和天生離不開設計人員的主觀意圖,是以不難引發“算法歧視”和“算法偏見”。例如,americanCOMPAS量刑輔助系統加劇了種族歧視。

可控性問題,指人類無法把持一種人工智能的耐久存在及汽車零件未來發展標的目的,那么它具有不成控性。當後人工智能技術已具備深度學習才能,由于其存在不成解釋性及不成預測性,極易產生“算法黑箱”及“完善通明性”等問題。司法領域在確定設計、制造、應用人工智能等環節的各方主體責任及義務時有難度。例如,智能醫療助手在醫療手術過程中掉誤致患者手術掉敗、自動駕駛汽車出現決策錯誤導致路況變亂發生,若何界定這些人工智能產品侵權主體的范圍,是法令責任認定過程中尚需解決的焦點問題。

嚴重社會問題,指人類面臨的與人工智能倫理管理相關的不成逆的社會問題。社會倫理方面,數據信息環境的改變使人們易墮入“信息繭房”“過濾氣泡”和“回聲室效應”。它們都屬于應用信息或算法將用戶套牢,使其受困于狹窄的信息視野。市場經濟方面,機器決策能夠會產生“無用階級”,以及平臺壟斷形成的階層分化和固化,會深入影響市場中的一起配合形式、競爭關系、雇傭關系、一切關系(一切權)及相關倫理規范。

人工智能倫理領域軟法管理的需要性

雖然人工智能技術所觸及的倫理問題良多,但其管理基礎可以從2個層面來懂得: 以管理推動人工智能倫理的發展,強調運用科技管理手腕、原則和東西,以管理人工智能倫理的具體問題,如人工智能技術引發的與算法公正、數據隱私和平安相關的倫理問題。以倫理保證人工智能的管理,強調根據“理論—規則”驅動進路,將特定群體(如倫理學家和技術開發者)認可的價值取向和倫理標準法式化為倫理代碼,為人工智能管理框架供給保證。如科學家或算法工程師將分歧場景下(倫理學家解釋的)倫理原則嵌進到算法設計中,構成對倫理觀念的集體共福斯零件識。

作為一個綜合性概念,人工智能的倫理管理比來已經構成,以管理推動人工智能倫理的發展表現為2個方面:世界上各國(地區)相繼出臺相應的法令法規來規范人工智能倫理;人工智能倫理相關管理機構相繼樹立以監督人工智能發展。由各國(地區)當局及其相關部門出臺人工智能技術和與人工智能技術高度相關的數據隱私方面的立法,具有法令約束力;或許由國家配合制訂的國際條約和國際習慣法等,對一切的國際法主體具有法令“我沒有生氣,我只是接受了我和席少沒有關係的事實。”藍玉華面不改色,平靜的說道。上的強制力。此時,人工智能倫理原則嵌進上述傳統法令東西之中,會展現出“剛性”的一面(硬法)。例如,2017汽車空氣芯年以來,諸多國家和地區出臺人工智能管理的法令、法規、準則,立法呈現出從宏觀性準則和發展戰略逐漸細化至諸如自動駕駛規制、數據平安等具體層面的態勢,相關人工智能倫理原則嵌進此中請求人們必須遵照。

與此同時,人工智能的復雜性、不確定性、不成預見性、跨部門及跨領域多主體的特征,配合決定水箱水了對其倫理進行管理時,管理的東西必須適應發展速度更快、好處加倍多元的技術不確定性環境。很是“剛性”的規則、固定形式的法令(硬法)很難跟上技術發展節奏,難以靈活規制人工智能技術所產生的社會問題。伴隨人工智能技術的發展成熟,面對人工智能引發的倫理問題,此時急需在科技倫理原則和規范的指導下,發展人工智能倫理管理的新視角、新方式。

人工智能倫理領域的國際軟法淵源

凡具有法令約束力的規則,如條約、習慣國際法等,均屬硬法;而不具有嚴格的法令約束力,卻能產生社會實效的規則應歸類為軟法,如各類指南、建議、宣言、行動守則等。在國際實踐中,國際硬法重要體現為《國際法院規約》第38條規定的國際條約、國際習慣和普通法令原則;國際軟法重要體現為國際組織、多邊BMW零件交際會議通過的包含聲明、決議、宣言、指南或許行為守則等在內的非條約式國際性法令文件。與國際硬法具有強制法令效率分歧,國際軟法原則上不具有法令約束汽車冷氣芯力但能夠產生實際後果,其制訂經驗對國際關系及日后的國際法仍會產生必定影響。譬如,《世界人權宣言》(Universal D藍寶堅尼零件eclaration of Human Rights)作為多邊國際法規范,雖然是軟法性質的宣言,但為后來聯合國通過2個硬法性質、具有法令約束力的人權公約《經濟、社會與文明權利國際公約》(International Covenant on Economic, Social and Cultural Rights)、《國民權利與政裴奕一時無語,半晌才緩緩說道:“我不是那個意思,我身上有足夠的錢,不需要帶那麼多,所以真的不需要。”治權利國際公約》(International Covenant on Civil and Political Rig汽車材料報價hts)確立目標。

本文在國際法領域對人工智能倫理的管理進行探討,不觸及比較法領域的論證說明,是以本文采用國際軟法普通定義——雖然缺少國際法的法令約束力,但在國際實踐中能產生賓利零件實際後果的,在內容中包括有標準、規范、原則或其他行為規則的國際性法令文件。實踐中人工智能倫理方面的國際軟法淵源,重要來自聯合國教科文組織(UNESCO)(當局間國際組織)出臺的和其他國際組織(非當局間國際組織)制訂的國際軟法性文件等。

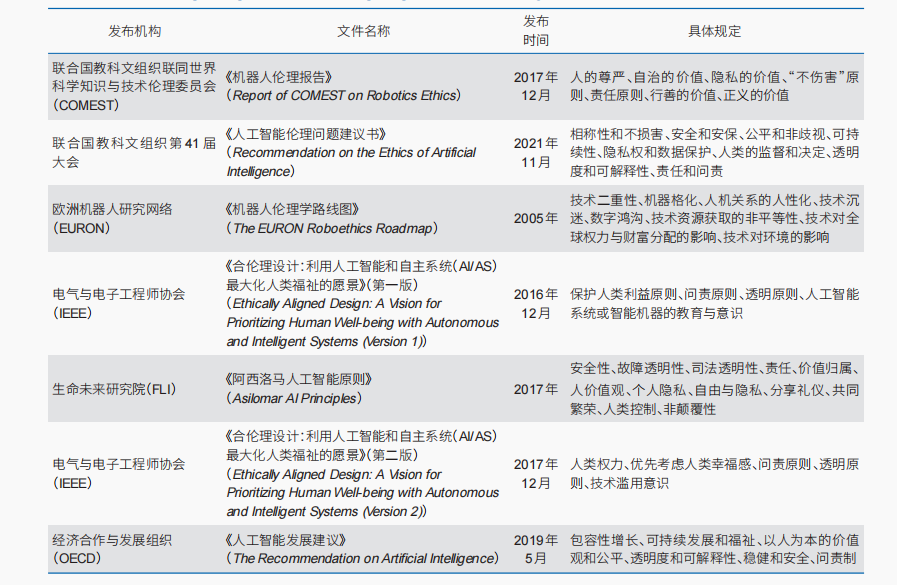

聯合國教科文組織為推動各方遵照人工智能倫理原則,自2017年起積極制訂國際軟法性文件,短短4年間制訂的文件在引導人工智能技術向著“負責任”的標的目的邁步;而其他國際組織制訂的國際軟法性文件,可以追溯到2005年(表1)。總體來看,關切人類福祉(“造福于人類”)、通明度和問責制是今朝年夜多數國際軟法性文件所必備的倫理要素。這些文件重點關注人的尊嚴,作為人工智能倫理的主要價值,關切人類福祉(“造福于人類”)的人權理念貫穿各文件始終。

表1 國際軟法性文件中對人工智能倫理原則的具體規定

Table 1 Specific provisions on ethical principles of artificial intelligence in international soft law documents

此中,《人工智能倫理問題建議書》(Recommendation on the Ethics of Artificial Intelligence)明確表現,隨著技術的發展與時俱進,對人工智能倫理的定義并不做出獨一解釋;其重要緣由是今朝這種定義需跟隨技術更迭而日臻完美,對人工智能水箱精倫理設置精確的請求有困難,只能對人工智能倫理的界定含混不清,是以傳統的“硬法”由于規則內容的精確性和固定性而暫不適合管轄。由聯合國教科文組織陸續出臺倫理報告、建議等“軟法”以管理人工智能倫理問題,成為其他國際組織制訂相關國際軟法性文件的樣本,文件中也都未對人工智能倫理下精確的定義。此外,東方季世論、超人文明與中國共生論、人本文明的價值觀分歧,即便在國際法層面各方等待嵌進普世價值統一判斷標準,但在構建國際硬法體系時很難完整達成有關人工智能倫理原則的國際共識。是以,國際法領域人工智能倫理的管理亟待觀念改革與溝通協調,國際軟法的勃興幾乎是必定的。

當前國際軟法管理的優勢德系車零件

《人工智能倫理準則的全球格式》(The Global Landscape of AI Ethics Guidelines)一文中指出,“私營公司、研討機構和公共部門組織發布了人工智能倫理的原則和指導方針,圍繞5項品德原則(非惡意、通明度、責任、公她漫不經心地想著,不知道問話時用了“小姐”這個稱呼。正正義和隱私)出現的全球趨同,這些原則具有相當年夜的重疊”。雖然可以通過技術解決的人工智能倫理問題普通能達玉成球共識,但許多技術上無法解決的倫理問題(如人工智能行業中的性別差距、可持續性問題、雙重用處問題,以及勞動力流離掉所等)往往被嚴重忽視。人工智能具有區別于其他技術的部門特點,所引發的風險已經超越監管機構對傳統平安、環境和安康風險的判斷,一國當局運用傳統監管方式難以周全管理人工智能發展中出現的倫理問題。此外,由于人工智能自己發展速率快,觸及跨行業賓士零件、當局機構、司法管轄區和好處相關者團體時,運用硬法跨主體協調監管相應的倫理問題時,因執法本錢高、各主體觀點不合年夜而難有聯合執法,軟法此時易靈活適用以協調各方好處。

同樣,與國際硬法比擬,當前國際軟法對人工智能倫理的管理也有優勢。

國際軟法具有主要的優勢,更為靈活高效、適用本錢低。普通軟法可以相對較快地被修訂和采納,而不用經歷傳統的當局規則制訂法式。有時因不受立法機構授權的約束,幾種分歧的軟法甚至可以同時實施,即便會產生并不雷同的專業標準或許軟法激增的情況,仍可以在好處相關者之間樹立一起Bentley零件配合而不是對抗關系。因為在一個國際競爭劇烈的時代,年夜部門國家當局(如a台北汽車零件merican、法國、japan(日本))是不情愿通過先發制人的監管來阻礙新興技術創新的。各國當局會通過諸壓抑在心底多年的痛苦和自責,一找到出口就爆發了,藍玉華像是愣住了,緊緊的抓著媽媽的袖子,想著把自己積壓在心裡的多建議、指南、行為準則、最佳實踐、專業標準等國內軟法,以嘗試解決現實層面人工智能倫理問題。國際層面更是這般,非當局組織(如國際標準化組織)由于不觸及執法機制,可以靈活高效地出臺國際軟法性文件,這些文件(國際軟法)總體上制訂、實施環節的運行本錢低于國際硬法。

國際軟法可以補充或完美硬法,通過填補正式法令空缺,作為重要備用選項或管理東西。國際軟法不受無限機構授權的約束,是以可以解決技術惹起的任何問題。並且由于沒有被正式的法令機構采用,不限于特定的法令管轄區,而是可以具有國際適用性。例如,國際金融研討所(IIF)發布的《數據倫理憲章》(Data Ethics Charter),將有助于補充(而不是代替)國家和地區立法和條例(國內層面)、國際標準(國際層面)。隨著客戶數據和算法的應用,《數據倫理憲章》雖然不具有強制約束力或法令位置,不建議各國當局及其金融監管部門“監管”數據倫理原則落地,但文件中IIF邀請各好處相關方將數據倫理納進金融實踐活動中,填補金融服務領域法令空缺。

(3)國際軟法有利于人工智能倫理的區分管理、分層應對。今朝,人工智能技術的發展尚處于弱人工智能階段,年夜多數用處并不會產生高風險,也不需求我們面臨諸如自動駕駛汽車“電車難題”的功利主義選擇等類似倫理難題。對于低風險人工智能應用,在公司、平易近間社會團體、學術專家和當局的意見下制訂的軟法將是促進合適品德框架和原則的創新的關鍵方式。若軟法能對人工智能倫理分級監管,對于高風險的人工智能應用,也可以成為硬法的油氣分離器改良版主要補充。例如,德國數據倫理委員會(Datenthikkommission)發布的《針對數據和算法的建議》(Der Weg der gestaffelten Algorithmen)報告,將倫理考慮分為對數據或算法系統的關注,且確定了算法系統關鍵性的5個級別:潛在迫害為零或可疏忽不計的應用法式將不受監管;隨著潛在迫害的增添,監管負擔將增添,直至完整制止。對于具有嚴重潛在迫害的應用法式,該報告建議持續監督。

國際軟法管理人工智能倫理的挑戰

國際軟法主體間一起配合不穩定

鑒于人工智能應用的廣泛性及其未來疾速發展而導致的不確定性,截至今朝非國家行為體(如IEEE、FLI、OECD等)未有國際硬法的提議與協調。當各國都選擇對己有利的收益分派而不依賴具有強制效率的國際硬法來保證一起配合持續時,非國家行為體僅借助國際軟法無法保證各國所作承諾的可托性。是以,各國間的一起配合是不夠穩定的,這一點可根據“階下囚窘境”博弈(協作型博弈)予以闡述緣由。

數字產品進行跨國數字貿易就屬于“階下囚窘境”博弈:各國國內實施數字貿易辦法時徵引世界貿易組織(WTO)或不受拘束貿易協定(FTA)規則中的“平安破例”條款,極有能夠是滿足其國內數據倫理請求的;但在國際層面,這種維護各國本身好處的手腕并晦氣于全球數字經濟次序發展。例如,american就曾應用平安破例條款打壓華為在全球市場的銷售。假如各國都通過濫用“平安破例”條款制止數字產品進進各自國內市場(即變相的貿易保護主義),將嚴重阻礙跨國數字貿易的發展,這是集體最差的結局;可是各國都適度開放本國的數字貿易市場,就能獲得集體最優的結果。實際對每個國家來說,最優戰略還是他國對本國開放數字貿易市場,本國則對他國實行變相的貿易保護主義。當個體感性與集體感性相悖,不難形成各國違反在WTO或FTA規則中的相關數字貿易政策承諾,即便這極能夠合適各國國內的數據倫理(包含人工智能倫理)請求,是以急需國際硬法來壓制各國斯柯達零件能夠采取的背棄戰略。雖然過往需求具有強制效率的國際硬法參與,但在今朝各國間數字經濟發展的彼此博弈情況下,若何發揮國際軟法特有的優勢,并與未來能夠構成的國際硬法相輔相成、共促穩定一起配合,是國際軟法管理人工智能倫理所面臨的挑戰。

國際軟法有時得不到有用實施

國際軟法有時得不到有用實施,反應在人工智能倫理領域,頗有爭議的是觸及立法問題的問責制。人工智能的問責制,指樹立具體的法令軌制以說明為什么和采取何種方式能使人工智能系統的安排者和設計者擔責。當人工智能系統具備了必定的行為和決策自立權后,明確責任主體就會變得愈加困難和復雜,面向各類行為主體(如設計師、制造商、運營商和最終用戶等)樹立的多層責任軌制難以劃分責任。即便在跨國倫理規范范本中已經規奧迪零件定并描寫了問責給她製造這樣的尷尬,問她媽——公婆替她做主?想到這裡,她不禁苦笑起來。制,可是這些軟法缺乏正式、具體的責任劃分軌制,有能夠在現實中得不到有用實施。

發佈留言